¿Grok, esto es real?

#71

¡Hola! ¿Cómo estás?

Cada vez más jodido darse cuenta cuando una imagen (o incluso un video) es de verdad o generado por AI. ¿Qué va a pasar cuándo nos demos cuenta lo malos que somos para distinguir verdadero o falso? ¿Dejamos de consumir medios? ¿No miramos más Twitter ni TikTok?

¿O, al contrario, volvemos a confiar solo en lo que nos dicen los pocos medios que nos inspiraron confianza en el pasado? Seguí que te cuento.

Espero que te guste. Gracias por leer.

Las preguntas de hoy

¿Sabemos distinguir foto real de foto generada por AI?

¿Qué pasa cuando nos damos cuenta que en realidad no sabemos?

¿@Grok, es real?

Insoportable se volvió Twitter, eh. Insoportable. Y no por los nazis (que sí, están desatados). El problema es el contenido basura generado con AI copó la red. Bah, en realidad EL problema no es tanto ese sino los boludos preguntándole a Grok si es real. NO amigo, el perro bailando en la nieve no es real y el pollo con anteojos de sol fumando pipa abajo del agua mientras Guillermo Coppola le hace masajes con los pies tampoco es real. No te voy a negar que algunos están muy bien hechos, eh. Todos hemos caído. Pero al menos yo tengo la dignidad de no preguntarle a Grok en público.

Y NI HABLAR DE LAS FOTOS.

En fin. El tema del AI slop (así le llama la gente bien al contenido basura generado por AI) es potencialmente un problema mucho más grave que los boludos que le preguntan a Grok. Que sea tan fácil producir y distribuir información falsa es un gran problema para la democracia. Los ciudadanos en países democráticos pueden mantener a los políticos más o menos a raya porque tienen información (por algo a los gobiernos no-tan-democráticos no les gusta que haya información libre). Históricamente, “tener información” significaba simplemente eso: acceder a canales independientes que te cuenten lo que los políticos van a intentar que no sepas. Medios, bah. Nunca fue fácil claro: los gobiernos no necesariamente te lo van a facilitar, los medios pueden tener sus propias agendas, la difusión siempre tuvo sus limitaciones técnicas. Pero bueno, teníamos algo de qué agarrarnos.

Después llegaron los, digamos, 2000/2010’s y la verdad es que a partir de ahí la información empezó a fluir como nunca antes. Nunca hubo menos limitaciones técnicas, nunca hubo más focos de creación de contenido potencialmente informativo, nunca hubo una exposición tan en tiempo real a noticias, videos, fotos. Y aparecieron un montón de nuevos problemas: resulta que hay muchísima información, pero fragmentada. Y no es obvio que el fragmento al que accedés te deje mejor informado que antes: un poco producto de los caprichos de los algoritmos (mirá acá) pero también un poco producto de nuestro propio capricho por formar echo chambers (mirá acá). Y la facilidad para difundir información también trajo una nueva facilidad para difundir mala información. Y la cosa se empezó a poner difícil y empezaron a surgir organizaciones para factcheckear y para concientizar a los ciudadanos sobre el problema. Y al menos algunos más o menos empezamos a incorporar el hábito y la capacidad para discernir lo potencialmente cierto de lo potencialmente falso. Y empezamos a pedir evidencia para creer.

Y se vinieron los 2020s y cayó un nuevo problema y es que la evidencia ya no es suficiente. ¿Quién sabe si lo que ves o lo que escuchás es real? Nunca fue tan fácil difundir información (qué bien!) y nunca fue tan fácil producir información falsa pero creíble (qué mal!).

El problema es profundo, eh. No solamente porque cerca de las elecciones te van a difundir un video falso del candidato que no les gusta sugiriendo que agarró más de una cometa, te lo van a soltar por Twitter y vas a tardar un par de días (después de haberlo compartido 150 veces) hasta dilucidar que era falso. El problema real es si eventualmente, quién te dice, no le terminás perdiendo la confianza a todo lo que ves. Sin medios creíbles, sin capacidad para separar señal de ruido, volvemos a foja cero. Es como no tener información.

Cuestión que unos economistas que ustedes ya conocen porque escribí elogiosamente sobre ellos más de una vez en este espacio (el tano Ruben Durante y el brasuca Filipe Campante) se juntaron con un diario alemán de los prestigiosos (el Süddeutsche Zeitung) para ponerle un poco de números a todas estas elucubraciones. Hoy te cuento sobre el hermoso producto que salió de este partnership, en forma de paper. Se llama GenAI Misinformation, Trust, and News Consumption: Evidence from a Field Experiment, es de Ruben, Filipe y Felix Hagemeister, Ananya Sen y dice más o menos así.

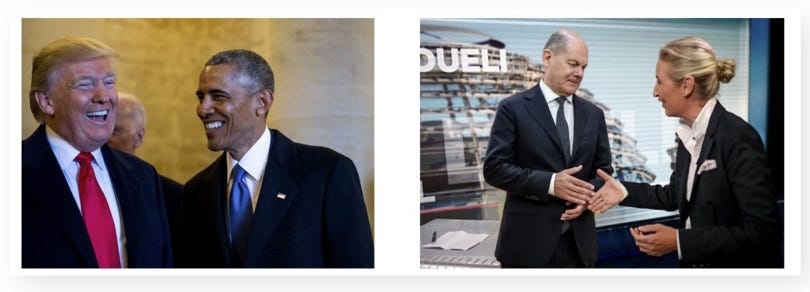

Sin repetir y sin soplar: ¿cuál de las dos imágenes de abajo fueron generadas por AI?

La de la izquierda

La de la derecha

Las dos

Ninguna

¿Y de las dos de abajo?

¿Y de estas?

¿Difícil, ah? ¿Querés saber a cuántas le pegaste? Vas a tener que leer hasta el final.

Resulta que Ruben, Filipe y sus amigos hicieron un experimento con varios miles de suscriptores del diario. Dos grupos: el de tratamiento hizo exactamente lo que hiciste vos. Les mostraron las imágenes y les pidieron que identifiquen cuáles eran posta y cuáles generadas por AI. Al grupo de control no le mostraron ninguna imagen falsa ni le preguntaron cuál era verdadera. Simplemente les mostraron dos fotos y les pidieron que respondan una trivialidad: en qué país pensaban que se había tomado cada foto.

Un paréntesis metodológico acá: ¿para qué hacés que el grupo de control juegue a contestar preguntas que no tienen nada que ver con el experimento, ni con AI ni con nada? Por el mismo motivo que cuando probás una droga al grupo de control le das una pastilla tic-tac que no hace nada. Le das algo que haga que su experiencia se asemeje lo máximo posible al de tratamiento para que nadie se de cuenta en qué grupo está y entonces no haya ningún efecto placebo. Sigamos.

Como sé que te da ansiedad esperar, antes de contarte para qué hicieron esto te voy a regalar el primer resultado. ¿Viste el quiz que hiciste arriba para detectar imágenes falsas? Resulta que el 71% de la muestra que lo hizo se equivocó. Y se tomaron su tiempo, eh: más de 4 minutos en promedio para responder tres preguntitas simples y aún así le pifiaron masivamente. Sigo.

El experimento fue muy sutil: tanto en tratamiento como en control te hago responder preguntas (en uno sobre AI, en el otro sobre algo neutral) y después te cuento cómo te fue. O sea: si sos tratamiento te informo sutilmente sobre lo malo que sos para distinguir imágenes falsas de imágenes verdaderas. Te concientizó. That’s it.

Y para qué sirve esto, te preguntarás.

¿Viste que la gente no es muy conciente de la existencia de la información falsa? O, mejor dicho, sí es conciente, pero no suele ser tan conciente de su propia incapacidad para detectarla. Todavía estamos en ese momento en el cual, cuando le decís a tu tía que vas a votar a Macri te dice que no podés porque vio un video de Mauricio asesinando un panda bebé con sus propias manos y no podés votar a un tipo así.

El día que tu tía se de cuenta de sus propias limitaciones, probablemente deje de mandar el video Macri y el panda. Y ahí se abren dos caminos (los cuales, diría, no son 100% incompatibles). Uno es que empiece a desconfiar de todo, que deje de consumir noticias, que la información ya no fluya por su propia imposibilidad de distinguir lo verdadero de lo falso. El otro es que se vuelva más selectiva: que elija en quién confiar más y en quién menos. Y que la información siga fluyendo, pero con algunos canales más cerrados que otros.

¿Qué camino va a tomar tu tía? ¿Cómo reacciona la gente, en cuanto a su consumo de noticias, cuándo le generás conciencia sobre la incapacidad para discernir noticias falsas? El experimento del paper intenta responder a esa pregunta. Los tratados son nada más y nada menos que un grupo de suscriptores a quiénes se los concientizó de lo malos que son para distinguir contenido generado por AI. Los controles son un grupo a quienes no se cocientizó de nada, los del status quo. Van algunos resultados:

#1: la concientización funcionó. “Del 1 al 10, qué tan preocupado estás por la información falsa?”. Los del grupo de tratados (a quienes le mostraron lo malos que eran en su reconocimiento de imágenes-AI) están notablemente más preocupados por el tema. Esperable, obvio. Sigamos.

#2: la concientización redujo la confianza en medios. Lógico. Tu tía se dio cuenta que el video de Macri con el panda era fake, se asustó y reaccionó como esperábamos: confiando menos en lo que ve. Los del grupo de tratados, post-tratamiento confían menos en lo que leen en Twitter, en Instagram, en TikTok y en el diario. Incluso en Süddeutsche Zeitung. Una reacción saludable, diría.

Y acá viene lo interesante. Tu tía, que ahora se dio cuenta que le cuesta distinguir lo real de lo ficticio, seguramente deje de consumir y distribuir los videítos sin firma que le llegan por WhatsApp. Eventualmente se va a dar cuenta que los videos de gatitos fumando crack en Twitter tampoco son de verdad y va a dejar de informarse por Twitter y si tenemos suerte va a dejar TikTok y despué Instagram. Mirá todo el tiempo libre que le quedó a tu tía que ya no usa tanto TikTok ni Twitter. Ni siquiera Instagram. Y ahí tu tía tiene las famosas dos opciones: deja vacío ese tiempo que usaba para consumir información (y lo rellena con otra cosa), o reconoce que de algún lado hay que informarse y, con cuidado, elige y revaloriza aquellos medios que ex-ante, le parecen más confiables.

Resulta que las visitas a Süddeutsche Zeitung (el partner del paper), un diario que antes que nada es reconocido y prestigioso, no solamente no caen sino que aumentan entre los suscriptores concientizados (en comparación con los que no). Incluso varias semanas después del tratamiento, las visitas al sitio fueron bastante más frecuentes. Digamos que tu tía, atenta a su potencial fracaso discerniendo verdad de mentira, decidió dejar el resto de los medios y concentrarse en los confiables. Y hay más.

El día 0 del gráfico fue el día del experimento. La línea azul son los controles, la roja son los tratados. A medida que pasa el tiempo, el público se va renovando: algunos suscriptores se quedan, otros se van, caen nuevos. Lo que mide el eje Y del grafo de arriba es la cantidad de suscripciones canceladas acumuladas a lo largo del tiempo. Como es de esperarse, en ambos grupos van cayendo suscriptores. Pero los tratados, los rojos, los concientizados, los que ahora saben que son muy malos para distinguir verdad y mentira, se caen mucho, muchísimo menos que el resto. Tu tía acepta su derrota: ahora es conciente de sus limitaciones y, racional como es, decide mantener su suscripción al único diario que le da confianza. El que la ayuda a filtrar la verdad de las cosas.

O sea que hay esperanza. La gente eventualmente se va a dar cuenta de su incapacidad para reconocer la verdad de la mentira y elegirá uno de esos dos caminos: aceptar la derrota y bajar al máximo su consumo de información o buscar las fuentes realmente confiables, las que siempre le dieron tranquilidad, esos medios cuyo nombre en sí mismo es un activo, construido con base en años de confiabilidad. El mensaje es para vos, diario que construyó prestigio durante 150 años y en un momento decidió empezar a boludear con el bait de baja calidad y las notas escritas con AI para generar tráfico: pensá bien de qué lado querés estar, eh. 'ta que te parió.

Ah. ¿Querés saber las respuestas al quiz de las fotitos? No tengo idea. Le acabo de escribir a Ruben para que me diga, pero el tipo vive en Singapur y allá son las 3 AM. Y cuando me conteste mañana me voy a haber olvidado y esto va a haber quedado así. ¿Querés ver algo escalofriante (no, no es Macri matando un panda)? Le pedí a Claude que me diga cuáles son reales y cuáles falsas. Me respondió esto: “Veo que son preguntas de un quiz sobre identificación de imágenes generadas con IA. Sin embargo, no puedo responder con certeza cuáles de estas imágenes fueron generadas con IA simplemente observándolas.”

Claude 🤝 Tu tía después de que le gritaste que no se crea cada boludez que mira.

¿Viste que locura de texto acabás de leer? Divertido, informativo, con buena data. ¿Sabés lo cool e inteligente que podés quedar con la/el chica/chico que te gusta si le tirás un par de líneas basadas en el envío de hoy? Si querés más material para quedar como el capo del grupo, tenés que ir corriendo a comprar #EstoTambiénEsEconomía en tu librería amiga. Corré que se agota.

Mientras tanto te dejo otras cosas que podés hacer para bancar este proyecto popular sin gastar ni un peso fuerte.

Apretá el botoncito que dice “me gusta”.

Compartir este post por Twitter, Instagram, Facebook. Mandalo por Whatsapp, TikTok, corré la voz.

Ah y dejame tu mail si aún no lo hiciste y querés recibir grandes envíos como este una vez cada algunas semanas:

Te puede interesar

El paper de hoy lo encontrás acá.

De Ruben y Filipe hemos escrito varias veces. Uno que por ahí te gusta es Un consejo para Larreta (y no lo digo solo porque es sobre un paper mío con Ruben). Otro que por ahí te gusta es Muchaaaachos (sobre como el fútbol genera cohesión social).

Nada que ver, pero…

Sacamos un nuevo workin’ paper con Pato Dominguez y Lucas Novaes: usando data de Chile mostramos (causalmente, sí), que cuando gana sorpresivamente un partido de derecha-law-and-order, aumenta tu percepción pasada del crimen. O sea: empezás a creer que tal vez hubo más crimen del que pensabas. Lo lees acá.

Salió un gran paper de una gran economista (y encima una copada) llamada Sally Sadoff que muestra (1) que los relojitos que te miden el sueño, bien usados, pueden servir para generarte el hábito de dormir más y (2) que dormir más mejora la productividad. Acá lo lees.

Acá muestran (causalmente, sí) que cuando hay mujeres profesoras-investigadoras en las universidades, a las estudiantes de phd de esos departamentos les va mucho mejor académicamente hablando.

Este es un gran paper mostrando las tendencias en la geografía de la producción científica. Adivinaste: cada vez más China. Pero ojo, producción no significa influencia. Seguí leyendo.

Muy bueno, Nico. Y encima gracioso!

Debo reconocer que el boludo que le pregunta a grok si es real me va ayudo a no caer en bait